‘AI’ เข้าใจและใช้เป็นคือผู้ช่วยชั้นดี แต่มนุษย์ยังต้องตรวจสอบความถูกต้องซ้ำ สื่อจะใช้ต้องแจ้งผู้รับสาร

18 ม.ค. 2567 ภาคีโคแฟค (ประเทศไทย) ร่วมกับ สำนักงานกองทุนสนับสนุนการสร้างเสริมสุขภาพ (สสส.) คณะนิเทศศาสตร์ จุฬาลงกรณ์มหาวิทยาลัย Google News Initiative (GNI) และสภาการสื่อมวลชนแห่งชาติ จัดการสัมมนาเชิงปฏิบัติการ “รับมือการตรวจสอบข่าวในยุค AI” ที่ห้องประชุมชั้น 11 อาคารมงกุฎสมมติวงศ์ คณะนิเทศศาสตร์ จุฬาลงกรณ์มหาวิทยาลัย

ในช่วงเช้า รศ.ดร.ปรีดา อัครจันทโชติ คณบดีคณะนิเทศศาสตร์ จุฬาลงกรณ์มหาวิทยาลัย ฉายภาพขั้นตอนการผลิตเนื้อหา ที่ในอดีตอาจต้องเริ่มตั้งแต่การวิจัย การทำภาพ ทำกราฟฟิก การหาข้อมูล ทำโปรดักชั่น บันทึกภาพและเสียง การใช้เทคนิคพิเศษต่างๆ แต่ปัจจุบันเทคโนโลยีปัญญาประดิษฐ์ (เอไอ-AI) ช่วยให้ขั้นตอนเหล่านี้มีต้นทุนต่ำและทำได้ง่ายเพียงการป้อนข้อมูลและใส่คำสั่งเข้าไป

อย่างไรก็ตาม เนื้อหาที่ปัญญาประดิษฐ์สร้างขึ้น (Generative AI) ก็ทำให้เกิดผลกระทบเชิงลบ เช่น ผู้คนเชื่อถือข้อมูลข่าวสารน้อยลง เพราะไม่รู้แล้วว่าอะไรจริง-ไม่จริง หรือไม่รู้แล้วว่าเนื้อหาใดทำโดยมนุษย์หรือ AI แม้แต่ผู้เชี่ยวชาญก็ยังแยกแยะได้ยาก ยิ่งเนื้อหาที่ผู้สร้างมีเป้าหมายเพื่อการหลอกลวงก็ยิ่งพยายามสร้างให้แนบเนียน ขณะที่ในทางกลับกัน ปรากฏการณ์แบบนี้ยังเอื้อประโยชน์ให้กับคนโกหก เพราะเมื่อมีภาพหรือคลิปวีดีโอเกิดขึ้น บุคคลที่ถูกพาดพิงอาจอ้างว่าภาพหรือคลิปนั้นถูกสร้างโดย AI ก็ได้ แล้วคนอื่นๆ ก็อาจเชื่อโดยไม่ตรวจสอบ

“นอกจากนี้ยังทำให้เกิดปรากฏการณ์ ‘หลอนมโนเอาเอง’ เวลาที่ Generative AI สร้างเนื้อหาใหม่ที่ดูน่าเชื่อถือ เป็นไปได้ แต่ที่จริงแล้วเนื้อหามันไม่ได้เท็จหรือมันอาจจะไม่ถูกต้องทั้งหมด แต่ว่าถูกนำเสนอให้เป็นข้อมูลความจริง ซึ่งลักษณะแบบนี้มันก็อาจจะมีข้อมูลที่ไม่ถูกต้อง เหมือนว่าจะเป็นจริงแต่ไม่จริง หรือเป็นการสร้างข้อมูลเท็จขึ้นมาเลย อย่างเช่นการสร้างเว็บไซต์ที่พูดถึงคน หรือพูดถึงอะไรบางอย่างที่ไม่ได้มีตัวตนอยู่จริง แล้วก็มีการทำบรรณานุกรมไปยังบทความ หนังสือ หรืองานวิจัยที่ไม่มีอยู่จริง แต่สร้างให้ดูน่าเชื่อถือ” รศ.ดร.ปรีดา กล่าว

ชวรงค์ ลิมปัทมปาณี ประธานสภาการสื่อมวลชนแห่งชาติ กล่าวว่า ปัจจุบันสภาการสื่อมวลชนแห่งชาติยังไม่ได้จัดทำแนวปฏิบัติเรื่องการนำ AI มาใช้ในงานข่าวแต่อย่างใด ซึ่งมีข้อถกเถียงว่าอย่างนี้ควรจะทำอย่างไร ดังกรณีที่เกิดขึ้นเมื่อเร็วๆ นี้ ที่มีการใช้ AI ทำภาพประกอบ ซึ่งทั้งๆ ที่มีภาพจริงแต่ไม่นำมาใช้เผยแพร่

โดยหลักแล้วหากนำ ภาพที่ถูกสร้างมาด้วย AI มาใช้ต้องแจ้งผู้รับสารด้วยเพื่อให้เกิดความชัดเจน ซึ่งนี่เป็นเพียงตัวอย่างเล็กๆ และเข้าใจว่าจะเริ่มมีความซับซ้อนขึ้นเรื่อยๆ

ทั้งนี้ ในมุมของภาพถือว่าเห็นชัดเจนแล้วเพราะมีกรณีที่นำ AI มาใช้กันมาก แต่ในส่วนของเนื้อหาข่าวอาจมีแต่ยังไม่ทราบเพราะผู้จัดทำเนื้อหาไม่ได้บอก นอกจากนั้น AI ยังไม่สามารถทำงานร่วมกับข้อมูลที่เป็นภาษาไทยได้มากนัก พบว่ามีข้อมูลที่ผิดพลาดคลาดเคลื่อน

“ความสามารถในการสร้างข้อมูลในภาษาไทย หากมีมากขึ้นเรื่อยๆ ก็อาจสร้างปัญหาเพิ่มขึ้นในแวดวงสื่อ ถ้าคนที่ทำสื่อนำเอา Generative AI มาใช้โดยไม่บอกกับผู้อ่าน หรือไม่ได้ทำตามหลักเกณฑ์หรือแนวปฏิบัติที่ถูกต้อง ซึ่งในที่ประชุมของสภาการสื่อมวลชนแห่งชาติก็มีการเสนอกันแล้วว่า วันนี้ก็น่าจะถึงเวลาแล้วที่สภาการสื่อมวลชนแห่งชาติก็จะต้องลงมากำกับดูแลเรื่องนี้เพื่อคุ้มครองผู้รับสื่อ” ประธานสภาการสื่อมวลชนแห่งชาติ กล่าว

สุภิญญา กลางณรงค์ ผู้ร่วมก่อตั้งภาคีโคแฟค (ประเทศไทย) กล่าวว่า ปัจจุบันเราอยู่ในยุคปฏิวัติอุตสาหกรรมครั้งที่ 4 โดยผ่าน 3 ยุคก่อนหน้า คือยุคเกษตร ยุคอุตสาหกรรม และยุคคอมพิวเตอร์เบื้องต้นรวมถึงสื่อสังคมออนไลน์ (Social Media) แต่หลังจากนี้ไปจะยิ่งก้าวกระโดดมากขึ้นด้วยศักยภาพของเทคโนโลยี ซึ่งล่าสุดเมื่อวันที่ 17 ม.ค. 2567 มีการจัดงาน Digital Thinkers Forum # เวทีนักคิดดิจิทัลครั้งที่ 26 “เราจะใช้เอไออย่างไรให้สร้างสรรค์และปลอดภัย” มีคำสำคัญคำหนึ่งคือ “at scale” หมายถึงผลผลิตและผลกระทบของเทคโนโลยีสามารถแผ่กระจายได้กว้างและรวดเร็ว จึงมีคำถามว่า ทักษะที่มีอยู่เดิมอย่างการตรวจสอบและรู้เท่าทันสื่อ เมื่อต้องสู้กับข้อมูลที่ถาโถมเข้ามา เราจะรับมืออย่างไร

ซึ่ง AI (Artificial Intelligence) หรือปัญญาประดิษฐ์ มาจากการประมวลผลทางสถิติของระบบคอมพิวเตอร์ โดยมีที่มาจากการรู้จักพฤติกรรมของเราเอง ทำให้ AI ก็อาจมีอคติ (Bias) ได้ ด้วยการแปลงข้อมูลที่สอดรับกับจริตความสนใจหรือความชอบของเรา อย่างในสื่อสังคมออนไลน์จะเรียกสิ่งนี้ว่า อัลกอริทึม (Algorithm) ดังนั้นเราจึงต้องตั้งสติก่อนเชื่อและแชร์ ทั้งนี้ ในเวทีนักคิดดิจิทัลครั้งที่ 26 มีการถกเถียงกันใน 2 มุมมอง ระหว่างฝ่ายคนทำงานด้านเทคโนโลยีที่มองเห็นโอกาสมากมายจาก AI แต่ฝ่ายที่ทำงานด้านสังคมก็จะกังวลเรื่องความเสี่ยงของผลกระทบ เพราะขนาดที่เป็นอยู่ระดับในปัจจุบันยังมีคนถูกหลอก และมีข้อเสนอหลายเรื่องที่แต่ละฝ่ายต้องทำ

“แพลตฟอร์ม เช่น ยูทูบ เอ็กซ์ (ทวิตเตอร์) กูเกิล ก็อาจจะต้องพัฒนาเครื่องมือในการที่จะมาตรวจสอบข้อมูลลวง สิ่งที่มันสร้างโดย AI เพื่อเตือนผู้บริโภคมากขึ้น แล้วก็ตัวสื่อมวลชนเอง ผู้บริโภคเอง ก็จะต้องทำอะไรบางสิ่งบางอย่างด้วย ก็เป็นที่มาต่อเนื่องกับวงในวันนี้ เพราะสุดท้ายส่วนหนึ่งก็คาดหวังว่าสื่อมวลชนจะต้องช่วยประชาชนในการที่จะตรวจสอบ อย่างกรณีภาพรถการ์ตูน มิตซูบีบิ สื่อควรจะต้องช่วยตรวจสอบข้อเท็จจริง แต่ปรากฏว่าสื่ออาจจะไปรายงานต่อเองด้วยไมได้ตรวจสอบข้อเท็จจริงว่าไม่ใช่รถมิตซูบิชิ แต่เป็นรถ AI เป็นต้น ในอนาคตมันอาจจะมีการพลาดแบบนี้ได้ง่ายๆ เมื่อวานก็มีข้อเสนอจาก ThaiPBS ว่าสื่อจะต้องมีการ Upskill-Reskill เพื่อทำให้มีเครื่องมือในการตรวจสอบความถูกต้องก่อนการเผยแพร่” สุภิญญา กล่าว

รศ.ดร.อลงกรณ์ ปริวุฒิวงศ์ หัวหน้าภาควิชาวารสารสารสนเทศ คณะนิเทศศาสตร์ จุฬาลงกรณ์มหาวิทยาลัย ฉายภาพการทำงานของสื่อมวลชน จากประสบการณ์ส่วนตัวที่เคยเป็นผู้สื่อข่าวมาก่อน โดยในอดีตจะมีการประชุมกองบรรณาธิการในช่วงเช้า ก่อนแยกย้ายไปทำข่าวตามที่ได้รับมอบหมาย ในการสัมภาษณ์แหล่งข่าวจะเทปคาสเซ็ตต์บันทึกเสียงพร้อมกับจดรายละเอียดลงสมุด ได้มองเห็นความเปลี่ยนแปลง เช่นสื่อหนังสือพิมพ์เริ่มใช้ภาพประกอบข่าวมากขึ้นแทนการมีแต่ตัวหนังสืออย่างเดียว มีการทำอินโฟกราฟฟิกประกอบ ไม่แยกระหว่างข่าวเบา-ข่าวหนัก

หรือในอดีตจำนวนสื่อก็มีน้อย หนังสือพิมพ์มีสิบกว่าฉบับ โทรทัศน์มี 5 ช่อง ผู้รับสารก็ไม่ต้องตรวจสอบมากนักเพราะเชื่อว่าคนทำสื่อหรือกองบรรณาธิการจะดูแลให้ แต่ปัจจุบันผู้สื่อข่าวอาจไม่จำเป็นต้องเดินทางไปฟังสัมภาษณ์ในสถานที่นั้นหรือไปหาแหล่งข่าว เพราะสามารถฟังหรือชมการถ่ายทอดสดผ่านช่องทางออนไลน์ หรือสัมภาษณ์แหล่งข่าวทางโทรศัพท์ ไปจนถึงใช้ AI ช่วยรวบรวมข้อมูลมาใช้เขียนข่าวโดยอ้างอิงว่าใช้ข้อมูลจากแหล่งใดบ้าง จากเดิมที่ในอดีตการหาข้อมูลต้องไปที่ห้องสมุด

ธนภณ เรามานะชัย ผู้เชี่ยวชาญด้านการตรวจสอบข้อมูล ภาคีโคแฟค (ประเทศไทย) กล่าวว่า AI ไม่ใช่เรื่องใหม่แต่ใช้กันมาเป็นสิบปีแล้ว อย่างเว็บไซต์ค้นหาข้อมูลอย่างกูเกิล ก็ใช้ AI ช่วยปรับปรุงให้การแสดงผลการค้นหามีประสิทธิภาพดีขึ้น แต่เป็นการใช้งานแบบหลังบ้านคือพัฒนาระบบกันภายในบริษัท ไมได้ใช้ในส่วนของผู้บริโภค แต่ผู้บริโภคจะได้รับผลการค้นหาที่แม่นยำขึ้น หรือช่องการค้นหาที่ใช้ AI มาช่วยคาดเดาว่าผู้ใช้งานต้องการพิมพ์คำใด เป็นตัวช่วยในกรณีที่ผู้ใช้งานสะกดคำนั้นไม่ถูก

ขณะที่ปัจจุบันมีฟังก์ชั่น “Bard” ใน Google Doc เป็น AI ที่สามารถสร้างเนื้อหาได้โดยใส่คำสั่งเข้าไป เช่น ช่วยสร้างใบเสนอราคา จดหมายเชิญ หนังสือเอกสารของทางราชการ เท่าที่ตนลองทดสอบพบว่าร่างออกมาได้แม่นยำพอสมควร ซึ่งอาจบอกว่าได้ Bard คืออีกระดับหนึ่งของการค้นหาในกูเกิล กล่าวคือ Bard จะรวบรวมข้อมูลโดยไม่ได้แสดงผลการค้นหาเป็น Link เว็บไซต์อย่างการค้นกูเกิลแบบเดิม แต่สรุปมาเป็นตัวหนังสือที่ประมวลผลมาจากคลังข้อมูล หรือ Google Sheets ที่ช่วยเขียนสูตรให้ เนื่องจากหลายคนอาจไม่ถนัดในการใช้โปรแกรม Excel เป็นต้น

“AI มันไม่ได้มีแค่ในส่วนที่เป็น Chat GPT Generative AI เท่านั้น ยังมีฟังก์ชั่นอื่นที่เราสามารถใช้งานได้ แล้วมันเกิดประโยชน์ในการทำงาน คือถ้าเกิดในมุมมองของนักข่าว ผมก็จะมองว่าอาจช่วยในการเขียนสคริปต์ ช่วยร่างสคริปต์ในเบื้องต้น ถ้ามันมีรายละเอียดอะไรค่อยมาใส่เพิ่ม มันก็จะช่วยได้ แต่สุดท้ายการทำงานในกองบรรณาธิการ เครื่องมือเหล่านี้มันมีอยู่แล้ว แต่เราต้องมี บก. หรือมีคนมาตรวจสอบเพื่อให้ข้อเท็จจริงมันถูกต้อง” ธนภณ กล่าว

พีรพล อนุตรโสตถิ์ ผู้จัดการศูนย์ชัวร์ก่อนแชร์ สำนักข่าวไทย อสมท. กล่าวถึงปัญหาที่เกิดขึ้นจากการมาของ Generative AI ในกรณีของต่างประเทศ เช่น การสร้างภาพลามกอนาจาร การสร้างบุคคลที่ไม่มีตัวตนขึ้นมามีบทบาททั้งการรีวิวสินค้า การโฆษณา ไปจนถึงอ้างว่าเป็นแพทย์ หรือการสร้างเรื่องราวที่ไม่เคยเกิดขึ้นจริง พร้อมกับนำตัวอย่างภาพจริงและภาพที่ AI สร้างขึ้นมาให้ผู้ร่วมงานสัมมนาดู ซึ่งพบว่าหลายภาพ AI ทำได้เนียนมากจนแยกไม่ออก หรือทำคลิปวีดีโอที่ดูเหมือนคนจริงๆ กำลังพูด กระทั่งจับสังเกตได้ว่าใบหน้าเบี้ยวและนิ้วมือผิดรูป

ในเบื้องต้นปัจจุบันมีเว็บไซต์หลายแห่งจัดทำขึ้นเพื่อตรวจสอบเนื้อหาที่ใช้ AI ทำขึ้น เช่น deepware.ai สำหรับตรวจสอบคลิปวีดีโอ หรือเว็บไซต์ isitai.com สำหรับตรวจสอบภาพ แต่ก็ตรวจได้เพียงระดับหนึ่งเท่านั้นไม่ใช่ทั้งหมด ดังนั้นอาจต้องดูรายละเอียดเพิ่มเติม โดยมีคำแนะนำจากต่างประเทศ เช่น สังเกตรอยต่อระหว่างหน้าผากกับเส้นผม ลักษณะของมือ เท้า ปาก ฟัน นิ้ว ว่าผิดปกติหรือไม่ ผิวเนียนเกินไปหรือไม่ หากเป็นคลิปวีดีโอคนในคลิปมีการกระพริบตาหรือเปล่า เพราะ AI จะไม่กระพริบตา แต่ AI ก็เก่งขึ้นเรื่อยๆ คำเตือนนี้จึงใช้ไม่ได้ตลอดไป

“ทั้งหมดนี้ผู้เชี่ยวชาญเขาก็ย้ำว่า มันใช้เครื่องมืออย่างเดียวไม่ได้ แต่ต้องใช้ร่วมกับการตั้งคำถาม ต้องคิดก่อนแล้วต้องพิจารณาว่า AI มันทำอะไรได้หลายอย่างแล้ว ก็ต้องใช้ร่วมกับ Media Literacy (การรู้เท่าทันสื่อ) แล้วก็ชวนมองไปข้างหน้าว่าเรื่อง AI ก็ต้องมี AI Literacy (การรู้เท่าทันปัญญาประดิษฐ์) ด้วยเหมือนกัน” พีรพล กล่าว

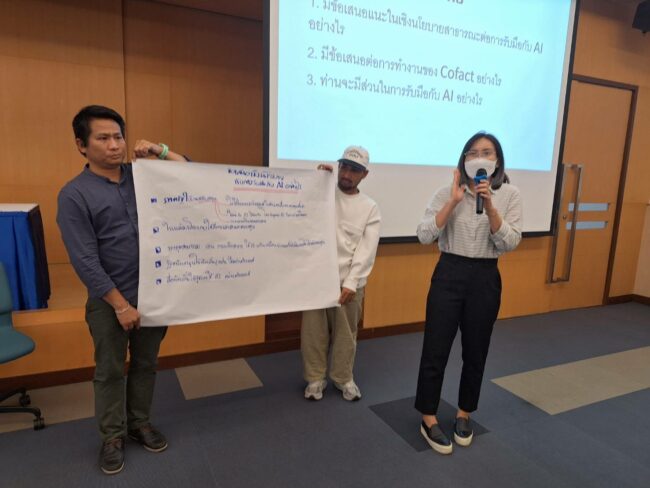

ส่วนกิจกรรมในช่วงบ่าย เป็นการบรรยายหัวข้อ “Tips and Trends สำหรับสื่อมวลชนในยุคเอไอ” โดย ผศ.ดร.สกุลศรี ศรีสารคาม อาจารย์ประจำคณะนิเทศศาสตร์ จุฬาลงกรณ์มหาวิทยาลัย ที่เริ่มต้นด้วยการย้ำอีกครั้งต่อจากวิทยากรในช่วงเช้า ว่า “สิ่งที่ AI ทำ คือการกวาดข้อมูลจำนวนมากจากคลังข้อมูลแล้วมาประมวลผลหาคำตอบที่คิดว่าตรงที่สุด” เช่น ตนเคยทดลองถาม AI ยอดนิยมอย่าง Chat GPT ว่าอยากสอนในสิ่งที่ยังไม่เคยสอน ผลคือมีข้อมูลขึ้นมาให้อ่านเป็นจำนวนมาก แต่ข้อมูลบางส่วนเหมือนกับงานวิจัยที่เพิ่งอ่านไปก่อนหน้านั้นไม่นานนัก

ดังนั้นแล้ว “AI จึงมีประโยชน์ในการช่วยค้นหาข้อมูลในเบื้องต้น แต่สุดท้ายการเรียบเรียงออกมาก็ต้องอาศัยมนุษย์ตรวจสอบความถูกต้องอีกครั้ง” มีตัวอย่างการทดลองใช้ AI ของกูเกิลอย่าง Bard ช่วยเขียนบทความโปรโมทร้านอาหาร แต่ข้อความนั้นก็ยังไม่สามารถนำไปใช้ได้ทันทีเพราะมีรายละเอียดบางอย่างไม่ตรงกับสิ่งที่เราต้องการ เนื้อหาที่ AI ประมวลผลมาจึงให้ดูไว้เพียงเป็นแนวทาง หรือใช้ช่วยตั้งชื่อหัวข้องานสัมมนา ก็จะมีข้อความขึ้นมา แต่สุดท้ายก็ต้องเอาไปให้เพื่อนที่เป็นครีเอทีฟช่วยเลือกข้อความที่น่าจะโดนใจคนมากที่สุด

แม้กระทั่งการทำคลิปวีดีโอ ถ่ายมาทั้งหมดยาว 1 ชั่วโมง จะตัดให้สั้นลง เช่น ตัดเหลือ 1 นาที สำหรับลงแพลตฟอร์มติ๊กต๊อก ซึ่งหากทำเองทั้งหมดจะเหนื่อยมาก ก็มีโปรแกรมที่ให้ AI ช่วย แต่การเลือกช็อตวีดีโอของ AI อาจไม่สอดคล้องกับสิ่งที่ต้องการนำเสนอ เช่น ผู้ใช้งานต้องการทำสารคดีวิถีชุมชนท้องถิ่น แต่ AI ไปตัดคลิปวีดีโอมาแต่ช็อตที่เป็นวิวสวยๆ AI จึงเป็นตัวช่วยย่นระยะเวลาและความเหนื่อยจากการต้องมาไล่สแกนฟุตเทจทีละช็อตทั้งชั่วโมง แต่สุดท้ายผู้ใช้งานก็ต้องตรวจสอบอีกครั้งก่อนนำไปเผยแพร่

“มันมีคำหนึ่งเสมอ มนุษย์ต้องควบคุมดูแลการใช้ AI เป็น ดังนั้นการรู้เท่าทันที่ดีที่สุดคือต้องรู้ว่าเราจะใช้มันทำอะไร ในกระบวนการไหน มันมีโอกาสจะผิดพลาดอยู่ตรงไหน และเราเป็นคนจัดการมันจนได้ชิ้นงานสุดท้ายที่มีคุณภาพออกมาอย่างไร นั่นคือหน้าที่ของเรา” ผศ.ดร.สกุลศรี กล่าว